Veštačka inteligencija (poznatija po engleskom akronimu AI) donela je revoluciju u naš svet, tako što je učinila poslove efikasnijim a zadatke lakšim. Međutim, pored svojih brojnih dobrih strana, veštačka inteligencija predstavlja i ozbiljan rizik, pre svega u smislu tehnologija kao što je dipfejk.

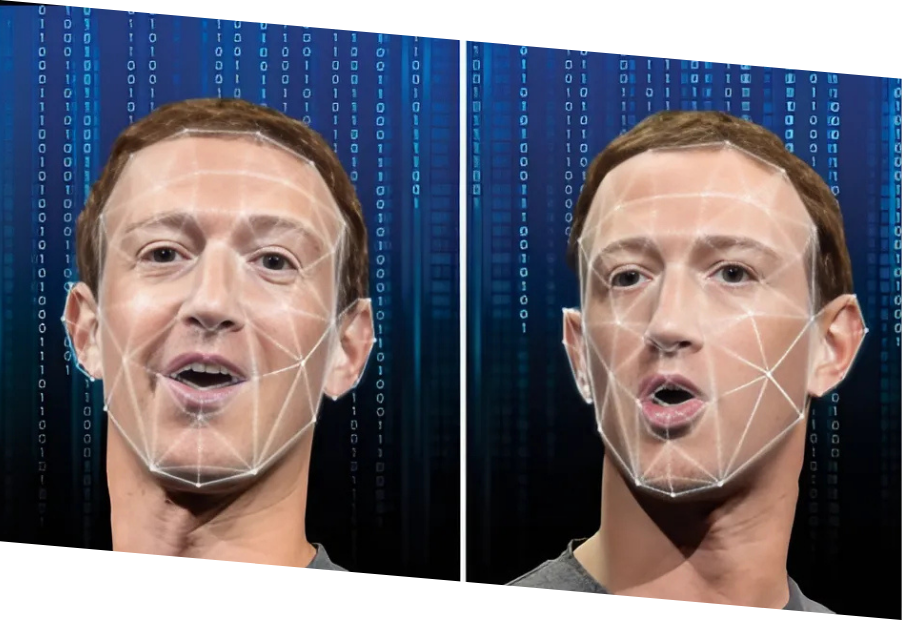

Dipfejk (deepfake) je uverljiva i realistična izmena na postojećim medijima koju prave algoritmi vođeni veštačkom inteligencijom koji manipulišu slikama, video ili audio snimcima kako bi imitirali prave ljude. Na primer, mnoge aplikacije i programi mogu da zamene lice na video snimku ili slici, animiraju ili izmene slike, oponašaju glasove sa neverovatnom tačnošću, ili čak da naprave potpuno lažne scenarije koji nenaviknutom oku mogu izgledati stvarno. Te tvorevine kreiraju modeli za mašinsko učenje koji analiziraju ogromne količine podataka kako bi kopirali šablone, glasove i vizuelne znakove.

Iako ova tehnologija ima potencijal za kreativnu i obrazovnu upotrebu, opasnosti koje nosi sa sobom ne mogu se zanemariti. Prvobitno viđena kao novina u industriji zabave za kreiranje smešnog ili ekskluzivnog sadržaja, dipfejk tehnologija je evoluirala u štetne aplikacije koje predstavljaju pretnju privatnosti, reputaciji, pravnom ustrojstvu i društvenom poverenju.

Dezinformacije i lažne vesti

Jedna od najvećih opasnosti dipfejka leži u sposobnosti da širi lažne informacije imitiranjem ljudi u različitim situacijama. Lažni video snimci javnih ličnosti ili običnih građana koji daju inflamatorne izjave ili se nedolično ponašaju, ili snimci kompromitujućih situacija mogu da postanu viralni i na taj način unesu razdor i zabunu. Skoro savršen realizam dipfejkova, kada se urade dobro, otežava publici da razlikuju činjenice od izmišljotina, što može negativno uticati na poverenje u legitimnost izvora finansiranja, uništiti reputaciju i prilike za zaposlenje ili dovesti do kampanja klevete, političkih sukoba i optužbi za kriminal.

Digitalno nasilje i maltretiranje

Dipfejk se koristi kao oružje za lične napade, posebno je izraženo nasrtanje na ranjive pojedince sa lažnim video snimcima ili slikama koji se mogu upotrebiti za digitalno nasilje, ucenu, ili narušavanje ugleda. Žrtve često imaju problem da dokažu da je sadržaj fabrikovan jer izgleda realistično, što ih ostavlja sa osećam bespomoćnosti i značajno utiče na njihove živote.

Finansijske prevare i pronevere

Imitacija glasa uz korišćenje veštačke inteligencije omogućila je kriminalcima da oponašaju organe vlasti, direktore firmi, zaposlene, umetnike i bliske ljude tokom telefonski poziva ili u audio porukama, čime mogu da ubede žrtve da im prebace novac ili otkriju osetljive informacije. Pored toga, veštačka inteligencija može se iskoristiti da zaobiđe prepoznavanje lica kako bi se pristupilo određenim uređajima. Ovi postupci iskorišćavaju poverenje i mogu izazvati veliku finansijsku štetu.

Narušavanje poverenja u medije

Kako postaje sve teže prepoznati dipfejk, javnost može početi da dovodi u pitanje autentičnost svih medija, sumnjajući u verodostojne izvore, što može dovesti do podrivanja novinarstva, naučnih dokaza, pa čak i lične komunikacije, stvarajući sredinu stalnog skepticizma i tle za teorije zavere.

Obrazovanje u oblasti digitalnih veština je prva linija odbrane od pretnji dipfejka. Svest o postojanju tih tehnologija i šta one mogu da urade je ključna za njihovo prepoznavanje i poništavanje njihovih efekata. Ovde je nekoliko koraka koje možeš koristiti da se zaštitiš od opasnosti dipfejka:

- Proveri izvore: uvek proveri izvor medijskog sadržaja više puta, posebno ako budi jaku emotivnu reakciju. Ugledne medijske kuće i servisi za proveru činjenica mogu ti biti od pomoći kada proveravaš autentičnost.

- Analiziraj doslednost: proveri da li su sadržaj, njegov izvor i njegovi meta podaci, zajedno sa tipovima ponašanja ili zahteva, u skladu sa drugim izvorima ili prethodnim dogovorima sa osobom ili osobama koje su prikazane u sadržaju.

- Koristi alate za detekciju veštačke inteligencije: pojavljaju se alati i softver koji detektuju dipfejk, iako je ta tehnologija u stalnoj trci sa kreatorima dipfejk sadržaja.

- Zalaži se za digitalnu pismenost: podučavanje digitalne pismenosti, kao što je razumevanje kako medijski sadržaji kreiraju i kako se njima manipuliše i analiziranje znakova o audio i vizuelnoj manipulaciji, pomaže nam da kritički procenimo šta vidimo i slušamo onlajn.

Projekat „DigiCity“ daje mladim ljudima veštine koji su im potrebne kako bi odgovorili na digitalne izazove poput dipfejka, tako što im pokazuje njihovu primenu i posledice kroz interaktivnu priču u video igri i igri bekstva. Koristeći učenje kroz igru, učesnici razvijaju kritičko razmišljanje da bi identifikovali sintetike medijske sadržaje i odgovorili na njih.

Povećanjem svesti i podučavanjem praktičnim strategijama, „DigiCity“ osnažuje generaciju odgovornih digitalnih građana koji mogu da se nose sa opasnostima zloupotrebe veštačke inteligencije. Zajedno možemo da obezbedimo da dobre strane tehnologije prevagnu u odnosu na rizike i da izgradimo bezbedniji digitalni.

Izvor slike: towardsdatascience.com

Za dodatno čitanje:

- Standford University IT. (2024). Dangers of Deepfake: What to watch for. https://uit.stanford.edu/news/dangers-deepfake-what-watch

- DHS Homeland Security. (n.d.). Increasing threat of DeepFake identities. https://www.dhs.gov/sites/default/files/publications/increasing_threats_of_deepfake_identities_0.pdf

- O. Lawal on CyberPhorm. (n.d.). What Is Deepfake and How Dangerous Is it For You and National Security? https://cyberphorm.com/what-is-deepfake-and-why-is-it-dangerous/

- Naik on CoolTechZone. (2022). Deepfake crimes: How Real And Dangerous They Are In 2021? https://cooltechzone.com/research/deepfake-crimes